AGXはロボティクスやメカトロニクスと相性がよく、日本の製造業を強くするものだと、エヌビディア日本代表 大崎真孝氏は話す。大崎氏は、2019年1月16日から国際展示場で開催予定の『第5回ウェアラブルEXPO』併設イベントである『第3回ロボデックス』のセミナーで講演予定。海外での大型展示会後だけに、当日は新たなトピックスが注目されるが、同講演を前に大崎氏を直撃してみた。

――まず最初に、エヌビディアは、ゲーマーやPCファンにとって、やはりグラフィックボードのメーカーでもあるわけです。しかし、現在はディープラーニングやAIで多くの企業から注目されています。AIに参入したきっかけはなんだったのでしょうか。

大崎氏:要因はいくつかあります。最初のきっかけはGPUを並列計算にも使えるように、アーキテクチャの変更と開発環境の提供を行い、CUDAというプラットフォームを作ることでした。CUDAを2006年に発表後、データセンターでエヌビディアのGPUの採用が増えました。シミュレーションなど大規模な演算処理に対応するためです。その後、2012年のImageNet(画像認識コンテスト)でトロント大学がGPUを使ってこれまでの認識率を画期的に向上させました。それまで何十年とかけて認識率を数ポイントずつ上げてきたのに、GPUを利用することで一気に10ポイント以上上がったのです。これ以降、ディープラーニングの学習処理、AI開発には、エヌビディアのGPUを使うというスタイルが定着していきました。

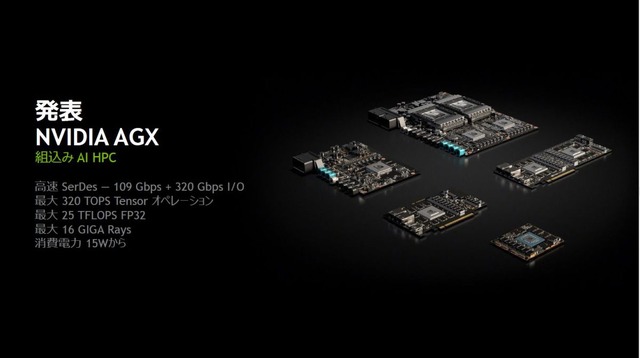

――ハイパフォーマンスコンピューティングからディープラーニングへの応用が広がったわけですね。しかし、GPUのディープラーニングへの応用は、データセンターなどで膨大なデータを学習させるための行列計算や演算処理を行う形が多いと思います。9月に発表したAGXは組込み用プロセッサのようですが。

大崎氏:IoT機器やロボットは常にオンラインであるかどうかわかりません。それを前提とした設計もできません。しかし、これらに要求される処理はどんどん複雑かつ高度になってきています。自動運転や産業ロボット、アシスタントロボット、カメラなどは、今後は自律マシンとしての機能が求められてきます。これまでも自動運転車両の車載用の製品(DRIVE Xavier、DRIVE Pegasusなど)を出しました。GTC Japanで発売開始を発表したJetson AGX Xavierでは、ロボットやIoT機器を意識してボードサイズなどをコンパクトにしました。ロボットの例でいえば、全体を制御する「頭脳」はひとつではなく、腕や足といったコンポーネントごとにAIが必要になってくるのです。

――組込み機器のプロセッサやコントローラーの場合、似たアプローチでFPGAを使ったソリューションがあります。こちらもAIの実装が可能だといいます。

大崎氏:他のソリューションとの違いは、AGXにはディープラーニング処理のためのコアに、他のエヌビディアのGPUと同じものが搭載されている点です。ソフトウェアプログラマに馴染みのあるC言語やPythonといった開発言語が使えて、PCやサーバー向けに開発したAIのプログラムを組込み機器に活用することもできます。我々はJetson AGX Xavierを「手のひらサイズのスパコン」と呼んでいますが、ディープラーニングやIoTでのAIコンピューティングを実現するもので、従来型の組込み機器と用途や機能が異なります。

制御システムやロボットなどのハードウェアは、一般に数年、数十年という単位で使いますが、ソフトウェアの進歩はもっと短いスパンで進みます。とくにAI技術の進化は早いので、ソフトウェアの更新が可能であることは重要です。スマートフォンにアプリを追加していくような機能拡張のアプローチもとれます。

――AGXシステムの具体的な事例にはどんなものがあるのでしょうか。

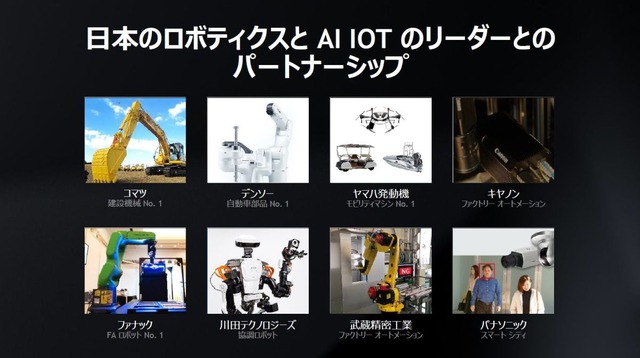

大崎氏:自動運転や自律走行の場面では、重機、ドローン、ボート、電動カートなどさまざまな乗り物や移動体をAIが制御しています。産業ロボットやファクトリーオートメーションへの応用も進んでいます。生産ラインでは検品、品質検査の画像認識にAI利用が広がっています。医療画像処理も同様ですね。品質検査において、ベテランや匠の技をAIが代用できるようになっています。

カメラは、単に画像認識するだけでなく高度な認知、状況分析を可能にします。最近では、カメラ画像だけでも、マスクをしている人も認識できたり、動画で何人も同時にトラッキングできるものもあります。

企業名でいえば、トヨタ自動車、いすず自動車、コマツ、ファナック、ヤマハ発動機、パナソニック、キヤノン、デンソー、ZMPなどですが、もちろんこれだけではありません。

AGXではない、サーバー、データセンターでの事例は、産業技術総合研究所のスパコン、ウェザーニュース、NTT、Preferred Networksなどです。

――2019年1月16日から開催されるロボデックスのセミナーにも登壇すると聞きました。どんなことを話す予定ですか。

大崎氏:まず、エヌビディアはなぜAI市場でリーダーシップを発揮できているのか。その背景にある新しい産業について話そうと思っています。また、1月にラスベガスで開催されるCESで発表する内容のフォローもするつもりです。

受講者にとくに聞いてほしいのは、さきほど挙げた国内企業のと協業や応用事例、海外の事例です。日本の製造業技術やロボット、メカトロニクスの技術は最先端を行っています。このような優秀なハードウェアはAIによってさらに価値を高めることができます。日本の製造業は、AIとの相性がよく、新しい価値が加わることで、新しいビジネスや産業にもつながっていきます。

ディープラーニングによるAIは、個別の機能を学習で精度を上げるフェーズから、ロボットや自動運転と社会に身近な部分への応用が広がっている段階です。セミナーでは、幅広い製造業の方にヒントになるような情報を提供できればと思っています。

■セミナーの紹介はこちら

■無料招待券の請求はこちら